在去年4月,威斯康星大学麦迪逊分校、微软研究院和哥伦比亚大学的研究者们联合发布了LLaVA(Large Language and Vision Assistant)。尽管LLaVA只是用一个小的多模态指令数据集进行训练,但在一些样本上展现出了与GPT-4非常相似的推理结果。然后在10月,他们推出了LLaVA-1.5,通过对原始LLaVA进行简单修改,在11个基准测试中刷新了SOTA。这次升级的结果非常令人振奋,为多模态AI助手领域带来了新的突破。

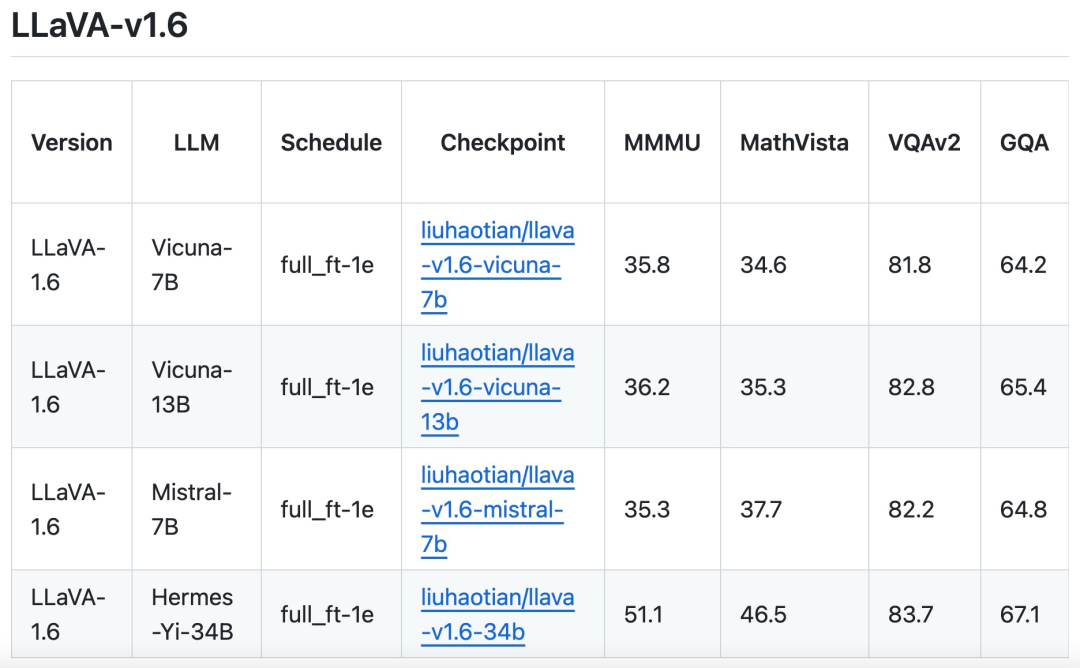

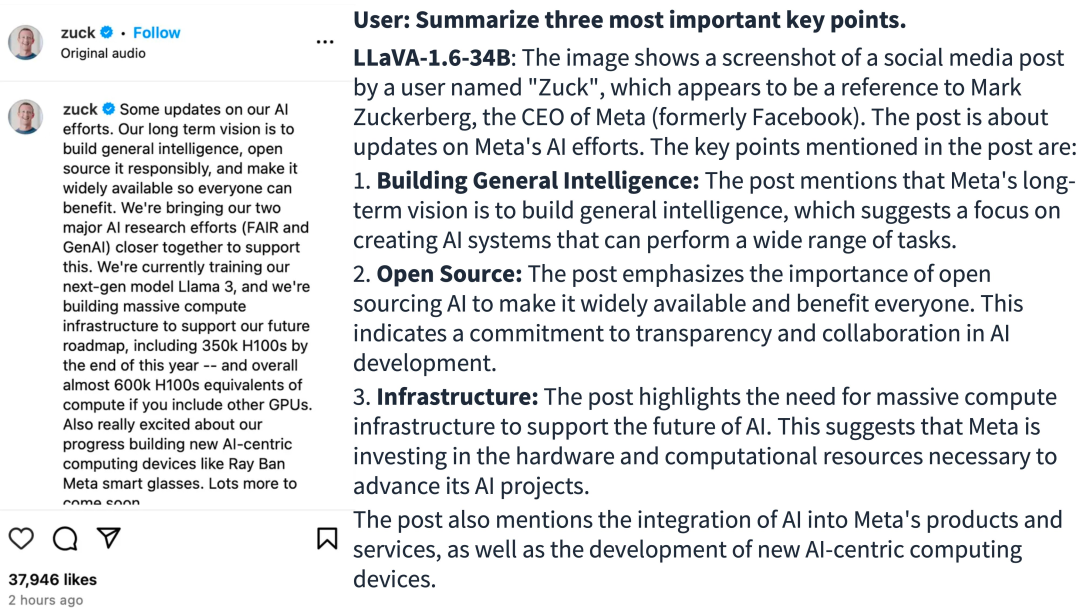

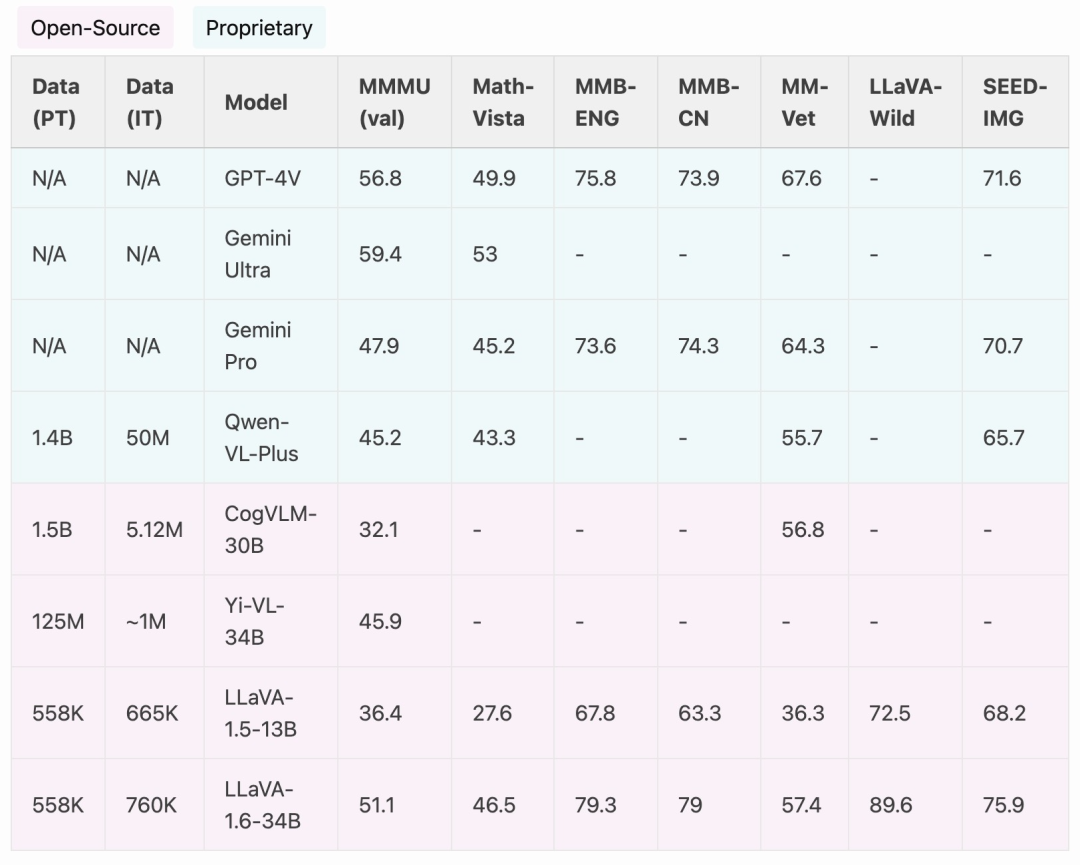

研究团队宣布推出LLaVA-1.6版本,针对推理、OCR和世界知识方面的性能进行了主要改进。这一版本的LLaVA-1.6在多个基准测试中甚至超越了Gemini Pro。

- demo 地址:https://llava.hliu.cc/

- 项目地址:https://github.com/haotian-liu/LLaVA

与 LLaVA-1.5 相比,LLaVA-1.6 有如下几个改进:

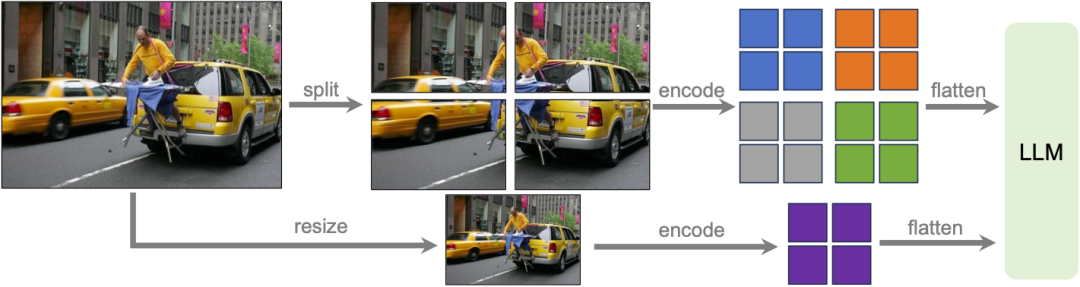

- 将输入图像分辨率提升 4 倍,支持三种宽高比,最高可达 672x672、336x1344、1344x336 分辨率。这使得 LLaVA-1.6 能够掌握更多的视觉细节。

- 通过改进的视觉指令调整数据混合,LLaVA-1.6 获得了更好的视觉推理和 OCR 能力。

- 更好的视觉对话,更多场景,覆盖不同应用。LLaVA-1.6 掌握了更多世界知识,具备更好的逻辑推理能力。

- 使用 SGLang 进行高效部署和推理。

图源:https://twitter.com/imhaotian/status/1752621754273472927

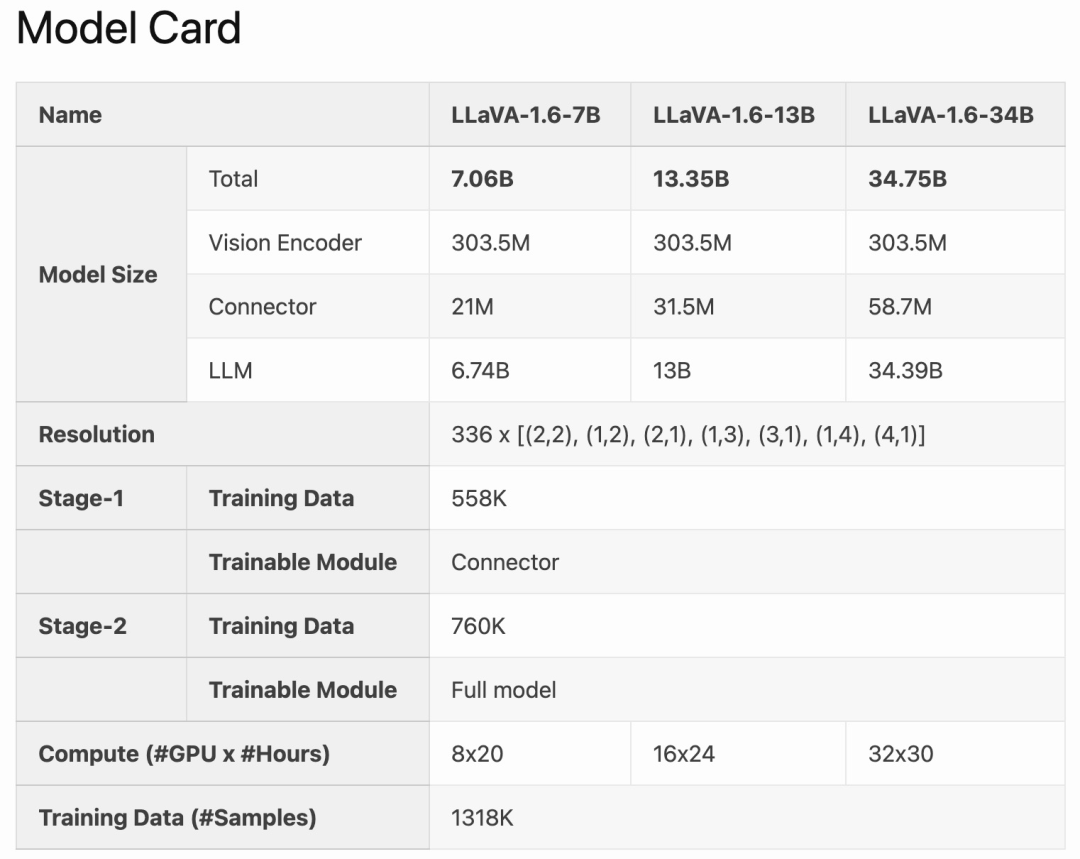

LLaVA-1.6 是在 LLaVA-1.5 的基础上进行了微调和优化。它保留了 LLaVA-1.5 的简洁设计和高效数据处理能力,并继续使用少于1M的视觉指令调优样本。通过使用32个A100显卡,最大的34B模型在大约1天内完成了训练。此外,LLaVA-1.6利用了130万个数据样本,其计算/训练数据成本仅为其他方法的100-1000分之一。这些改进使得LLaVA-1.6成为一个更加高效和经济实惠的版本。

与 CogVLM 或 Yi-VL 等开源 LMM 相比,LLaVA-1.6 实现了 SOTA 性能。与商用产品相比,LLaVA-1.6 在选定的基准测试中可以媲美 Gemini Pro,并且优于 Qwen-VL-Plus。

值得一提的是,LLaVA-1.6 展现出强大的零样本(zero-shot)中文能力,它在多模态基准 MMBench-CN 上取得了 SOTA 性能。

方法改进

动态高分辨率

研究团队以高分辨率设计 LLaVA-1.6 模型,旨在保持其数据效率。当提供高分辨率图像和保留细节的表征时,模型感知图像中复杂细节的能力会显著提高。它减少了面对低分辨率图像时的模型幻觉,即猜测想象的视觉内容。

数据混合

高质量的用户指令数据。该研究对高质量视觉指令遵循数据的定义取决于两个主要标准:首先,任务指令的多样性,确保充分代表现实场景中可能遇到的广泛用户意图,特别是在模型部署阶段。其次,响应的优先级至关重要,旨在征求有利的用户反馈。

因此,该研究考虑了两个数据源:

现有的 GPT-V 数据 (LAION-GPT-V 和 ShareGPT-4V);

为了进一步促进更多场景下更好的视觉对话,研究团队收集了一个涵盖不同应用的小型 15K 视觉指令调优数据集,仔细过滤了可能存在隐私问题或可能有害的样本,并使用 GPT-4V 生成响应。

多模态文档 / 图表数据。(1) 从训练数据中删除 TextCap,因为研究团队意识到 TextCap 使用与 TextVQA 相同的训练图像集。这使得研究团队能够在评估 TextVQA 时更好地了解模型的零样本 OCR 能力。为了保持并进一步提高模型的 OCR 能力,该研究用 DocVQA 和 SynDog-EN 替换了 TextCap。(2) 借助 Qwen-VL-7B-Chat,该研究进一步添加了 ChartQA、DVQA 和 AI2D,以更好地理解图和图表。

研究团队还表示除了 Vicuna-1.5(7B 和 13B),还考虑采用更多 LLM 方案,包括 Mistral-7B 和 Nous-Hermes-2-Yi-34B,以使 LLaVA 能够支持更广泛的用户和更多的场景。